Heure de réveil : 4h36

Tu sais quoi ? Je vais faire comme la semaine dernière et faire JOKER ce matin.

Sauf qu’hier, je me suis souvenue que j’avais le meilleur des joker.

« Le Dictionnaire du Monde Actuel » (ils précisent même pas l’année, tsé, c’est le Monde Actuel) de 1967 (date d’édition).

J’ai trouvé ça dans les recoins de la bibliothèque de la maison de famille de mon très cher époux. On se calme, c’est une ancienne forge dans un village loin de tout et d’internet, c’est pas une villa aux Canaries.

Je vais voir si je trouve une appli d’OCR correcte sur Android. En tout cas, je me suis spoilée un peu et l’aperçu de la réalité de 1967 est un peu étrange, j’ai l’impression d’être dans un tout autre monde. Comme si j’étais heu dans le passé, tu vois ? Genre en 1967. Incroyable.

C’est dommage que ce soit pas en odorama, parce que l’odeur d’humidité est assez désagréable, j’aurais bien aimé partager ça avec toi qui poste des images inspirantes sur l’odeur des vieux bouquins.

Précision : Les auteurs sont Charles-Henri Favrod et André Fougerousse. Le premier est bien documenté sur Wikipedia, je n’ai pas retrouvé le second en deux clics.

Le livre est édité en Suisse, je ne m’attends donc pas à de franches prises de position krr krr krr.

☀☀☀

Avant propos :

« Le Dictionnaire du monde actuel reproduit, dans l’ordre alphabétique, une partie des articles de l’Encyclopédie du monde actuel (Edma) tels qu’ils furent publiés sur fiches perforées hebdomadaires. C’est d’ailleurs pourquoi nous avons maintenu la date de parution qui figure à côté de chacun des mille titres suivants. »

Des fiches perforées ?

(Visiblement c’est un truc de documentaliste, je ne parviens pas à trouver à quoi ça ressemblait)(J’ai fini par trouver que c’était comme mes fiches Tintin que je recevais sur abonnement et qui coûtaient un rein)

Allez on commence facile.

Informatique (10 novembre 1965)

Série B-4 Fiche n°8231. Le néologisme Informatique désigne en principe l’ensemble des sciences et des techniques relatives à la recherche, la conservation, la mise en ordre et l’interprétation des informations. Une information est un ensemble de signaux (parlés, écrits, dessinés, etc.) susceptibles de déclencher dans l’activité humaine des réactions (individuelles ou collectives) qul mettent en jeu une quantité d’énergie bien plus grande que n’en porte l’information. Lancée en 1948 par Shannon, là théorle de l’information permet notamment de quantifier les problèmes de communication. Mais la technique vise en outre à modifier l’information elle-même et à résoudre les problèmes qui s’y attachent. Dans son sens restreint et courant, l’informatique est le traitement de l’Information.

« Le néologisme » ❤️

Aaaaaaaaaw ♥

Le Larousse nous donne cette définition en 2021 :

« Science du traitement automatique et rationnel de l’information considérée comme le support des connaissances et des communications.

Ensemble des applications de cette science, mettant en œuvre des matériels (ordinateurs) et des logiciels. »

On sent que pas mal de choses sont passées par là, notamment car on ne redéfinit pas le terme d’information. De même, le terme « logiciel », qui date de 1953, n’est pas précisé, tant il est entré dans notre quotidien.

C’est pas mal expliqué, en fait, les explications « simples » sont souvent les meilleures. Je suis persuadée que c’est une meilleure explication que celle, répandue chez les usagèr-es, de dispositifs magiques enfermés dans un boîtier solide. C’est même intéressant de voir qu’en 2021 ça a un côté délicieusement suranné alors que c’est la base. Pourquoi repréciser des termes avec lesquels nous vivons depuis toujours ? Pace qu’on est en 1967.

Je te laisse chercher « Théorie de l’Information » sur ton moteur de recherche favori, j’avoue qu’il y a plus amusant à lire à 5h35. Pour moi, en tout cas.

🐥🐥🐥

« 2. L’outil le plus puissant de l’informatique est la machine à traiter l’information ou ordinateur (on dit aussi: computeur, calculateur, calculatrice). Contrairement aux classiques machines à calculer, les ordinateurs travaillent sans autre intervention humaine que la fourniture initiale des instructions et données.

Bon, alors là ça a un peu changé. Et on voit qu’en 1965 on s’en cogne toujours autant du support technique et fonctionnel, parce que « sans autre intervention humaine » c’est cracher au visage des pauvres gens qui ont installé tout le merdier dans un gymnase pour sortir 2 ko de données. J’exagère peut-être. OU PAS !

Informatique en 1965, Wikipedia

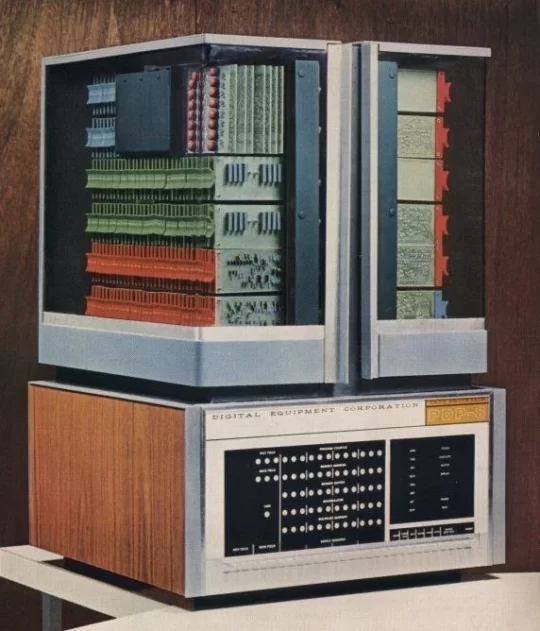

🍓 Digital commercialise le premier mini-ordinateur, le PDP-8

🍓 Développement du super ordinateur soviétique BESM-62, doté d’un processeur 48 bits de 9 MHz produisant une puissance de 1 MIPS

🍓 Premier super ordinateur à architecture vectorielle : l’ILLIAC IV de Burroughs Corporation équipé de 64 processeurs

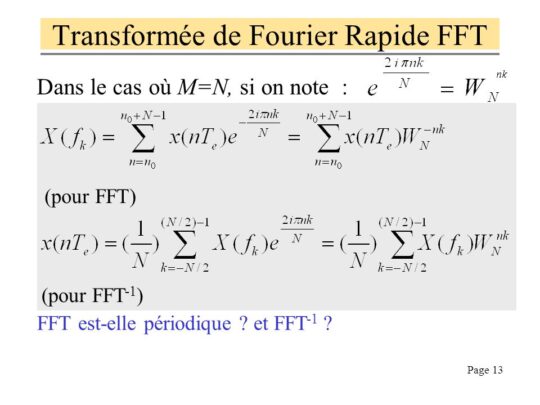

🍓 Cooley et Tukey publient leur article fondamental sur la transformée de Fourier rapide.

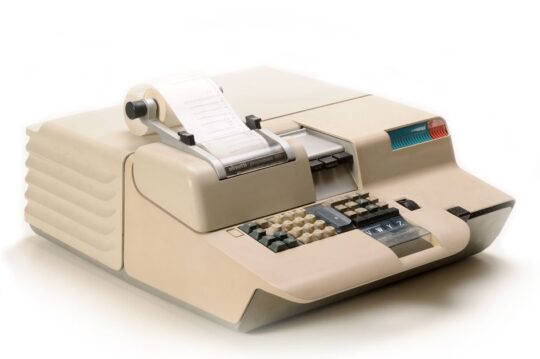

🍓 Commercialisation par Olivetti du Programma 101, premier ordinateur personnel programmable, utilisé par la NASA

- Programma 101

- BESM

- PDP-8

- ILLIAC IV

🤖🤖🤖

3. Un ordinateur comprend un nombre variable d’unités spécialisées: unités d’entrée des données, mémoires, organes de calcul, unités de sortie des résultats. A l’entrée, la machine lit les données et instructions enregistrées sur des cartes ou bandes perforées, ou sur des documents écrits en caractères magnétisables. Ces éléments, ainsi que les résultats partiels et définitifs, sont enregistrés sur des mémoires. Les mémoires externes, reliées électriquement à la machine, sont des rubans, disques ou feuillets magnétiques, amovibles et interchangeables. Les mémoires internes sont des matrices de tores magnétiques ou des tambours magnétiques. Les organes de calcul sont des circuits électriques qui utilisent la notation binaire et effectuent des opérations logiques à partir des éléments fournis par les mémoires, auxquels ils renvoient les résultats. A la sortie, ceux-ci s’inscrivent sur des supports analogues à ceux de l’entrée, ou bien ils sont imprimés par des imprimantes.

Je suis un peu émue en lisant ça, j’avoue. Ça semble tellement lointain ! D’un autre côté, à peu de choses près, la description tient toujours la route. Le coup des fiches perforées, ça remue quelque chose à la nerd qui sommeille en moi. Ouais, je suis un peu émue 🙂

🍭🍭🍭

4. Les ordinateurs effectuent en quelques secondes ou minutes des calculs qui demandaient des années. lls résolvent scientifiquement des problèmes jusqu’ici traités empiriquement à cause du trop grand nombre de paramètres. Leur emploi s’est étendu à d’innombrables branches d’activité: recherche scientifique, lancement d’engins, astronautique, gestion des entreprises, comptabilité, etc.

Et 56 ans après, 56 ans seulement, mon téléphone est plus puissant que, sans doute, tous les ordinateurs du monde de 1965. Ptet pas, mais…

Je me demande si l’énergie physique dépensée par mes doigts courant sur le clavier, ne serait-ce que pour traiter mon texte sur Keep, avec les allers-retours dans le cloud, est un million ou un milliard de fois plus importante que celle d’un Olivetti Programma 101.

Impossible pour moi, là, de calculer, mais si tu te sens de le faire (pour comparaison, j’ai un OnePlus 6T. 250Go de mémoire, 6Go de RAM, CPU octacore, 2.8 GHz de processeur, dans 185 grammes de matériel.)

La « mémoire » du Programma 101 est de 240 bytes et il pèse 35,5kg

« En 1965, pas de microprocesseur, pas de mémoire RAM, pas de ROM. C’est une ligne à retard qui fait le travail. Il s’agit d’un fil métallique ou l’on stocke l’information séquentiellement sous forme magnétique. La longueur détermine la capacité de calcul. La Programma dispose de dix registres de 22 chiffres et 48 instructions. On opère ensuite avec une logique à transistor et par déplacement de contenu. Les registres sont sécables pour optimiser l’utilisation et libérer de l’espace.

En ajoutant aux instructions arithmétiques une possibilité de saut conditionnel, Perotto construit le calculateur complet. Un judicieux système de cartes magnétiques permet de gérer la programmation par cartes, l’imprimante se chargeant d’afficher les valeurs numériques.

Le nombre d’instructions est limité, et c’est à l’opérateur de savoir jongler pour opérer les calculs souhaités. L’exemple le plus simple et le plus parlant montre la simplicité du système :

Pour effectuer l’incrémentation de 1 du registre A, soit A=A+1, on divise A par lui-même et on ajoute le résultat à A… »(Silicium.org1)

Un peu compliqué pour moi de comparer.

Si tu veux essayer de voir ce que ça faisait, des gens ont dev un simulateur d’Olivetti Programma 101((https://ub.fnwi.uva.nl/computermuseum/p101emul.html)).

T’imagines, en 56 ans ? 1965 c’est pas SI loin. Il y a 100 ans on était en 1921, quand même. Niveau IT je sais pas où iels étaient en 1921…

On va voir ça.

« Nous devons la première programmation binaire (carton/trou) à Joseph-Marie Jacquard en 1801. Il s’agissait d’un procédé industriel visant à accroître la productivité des métiers à tisser.

En 1834, Charles Babbage, considéré comme l’authentique grand-père des ordinateurs modernes, invente la machine analytique en s’inspirant des cartons perforés de Jacquard. La machine analytique n’a jamais vu le jour de son vivant, car la Couronne britannique lassée de la longueur des recherches de Babbage a décidé de lui retirer son soutien financier. L’un de ses fils en construisit l’unité centrale (le moulin) et l’imprimante en 1888 et fit une démonstration réussie de calcul de table à l’Académie royale d’astronomie en 1908. »

(Eoris2)

Hé bhé !

« Le développement de l’informatique est lié à la recherche fondamentale en mathématiques et plus précisément à la logique et aux algorithmes mathématiques, apparus au début du 9ème siècle avec les travaux du mathématicien arabe Abu Jaffar Al Khawarizmi.

L’informatique a bénéficié en outre de l’introduction du calcul binaire en Europe vers 1697, grâce aux travaux Gottfried Wilhelm Leibniz , à la formalisation du principe des machines à calculer par Ada Lovelace en 1840 et à la théorisation de la logique binaire par George Boole en 1854. »

Autanttemps pour moi (oui je sais jamais lequel choisir), je voyais ça moins ancien (mais ça se comprends si on part des maths). Mais, regarde, entre Ada Lovelace et 1965 il y a 125 ans. Entre l’Olivetti et mon OnePlus, il n’y a que 56 ans. La machine de Turing date de 1936

« John von Neumann [en] supervisa la construction [de la machine de von Neumann] de la fin de 1945 jusqu’en 1951 au sein de l’Institut for Advanced Study. Julian Bigelow fût l’ingénieur chargé de construire cette machine destinée à un usage balistique. Les ingénieurs n’étaient pas des physiciens théoriciens, ils travaillaient au fer à souder et ce sont des femmes qui assuraient le plus gros de la programmation. »

DES FEMMES ! OH MON DIEU PERSONNE NE RESPECTE LA LORE ICI OU QUOI ? Des femmes, en 1950 ? Tu plaisantes ? On a inventé les femmes en 1975, ton truc colle pas, là, je n’y crois pas un seul instant.

On sait bien qu’il n’y a pas de femme en informatique, ça se saurait, ouais ! Et puis quoi, encore, des personnes racisées ? Pfff 🙄

« en 1968, Douglas Engelbart, du Stanford Research Institute, présente un environnement graphique avec des fenêtres qui sont ouvertes et fermées via un pointeur relié à l’ordinateur par un fil : la souris, première interface homme-machine est née. »

L’émotion étreint mon petit octocore ♥

🍄🍄🍄

5. Pour confier un problème à un ordinateur, on passe par plusieurs étapes: analyse du problème; rédaction d’un organigramme fonctionnel, puis d’un organigramme machine; traduction de cet organigramme en une série d’instructions lisible pour la machine, ou programme. La nature des calculs à effectuer peut être notée en un langage spécial, langage algorlthmlque; le plus connu, établi par une commission internationale, est le langage Algol. Les carrières de l’informatique sont en pleine expansion, et selon les prévisions des ordinateurs eux-mêmes, l’offre de travail, dans ce domaine, surpassera longtemps la demande.

Niveau carrières en tout cas, on est raccord. Je ne sais pas s’iels avaient anticipé la méthode Agile et tous ces post-it. A mon avis non, parce que sinon iels auraient cramé leurs inventions directement.

En 1964, le langage Basic était inventé.

« Le langage Basic a été conçu en 1964 par John George Kemeny (1926-1993) et Thomas Eugene Kurtz (1928-) au « Dartmouth College » pour permettre aux étudiants des filières non scientifiques d’utiliser des ordinateurs. Le langage a été implémenté par une douzaine d’étudiants, parmi lesquels Mary Kenneth Keller, une des premières personnes et la première femme à obtenir un doctorat en informatique aux États-Unis. »

Mary Kenneth Keller ? Sans doute une grossière erreur. C’est Kenneth Mary Keller, voilà tout, 1975 pour les femmes on te dit.

🐙🐙🐙

Et bah tu vois, c’est un billet joker où on apprend des trucs. C’était assez sympa, pour moi en tout cas, j’espère que tu ne t’es pas ennuyé-e, dans le doute je vais rajouter deux trois conneries dans le texte.

Voilà.

Pis finalement ça te fait quand même un peu de lecture, dis, c’est pas mal ?

A demain ♥